AutoGluon:把机器学习 Baseline 简化到几行代码

在很多机器学习项目里,真正消耗时间的往往不是训练模型本身,而是训练前后的一整串工程摩擦:字段类型识别、缺失值处理、类别编码、特征筛选、模型选择、调参、交叉验证、结果记录、推理速度评估、错误样本回看……

这些工作当然重要,但它们不应该在每个新数据集上都从零开始。尤其是在项目早期,我们通常需要的不是一个已经完美部署的生产模型,而是一个足够可靠的性能锚点:这个数据集大概能做到什么水平?目前的数据质量是否值得继续投入?人工特征工程还能带来多少边际收益?

这就是我理解 AutoGluon 最有用的地方:它不只是帮你少写几行代码,而是把一套强 baseline 方法论固化成默认工作流。你给它一个数据表和目标列,它会自动完成大量脏活累活,并用一组可比较的模型结果告诉你:当前数据能撑起怎样的机器学习上限。

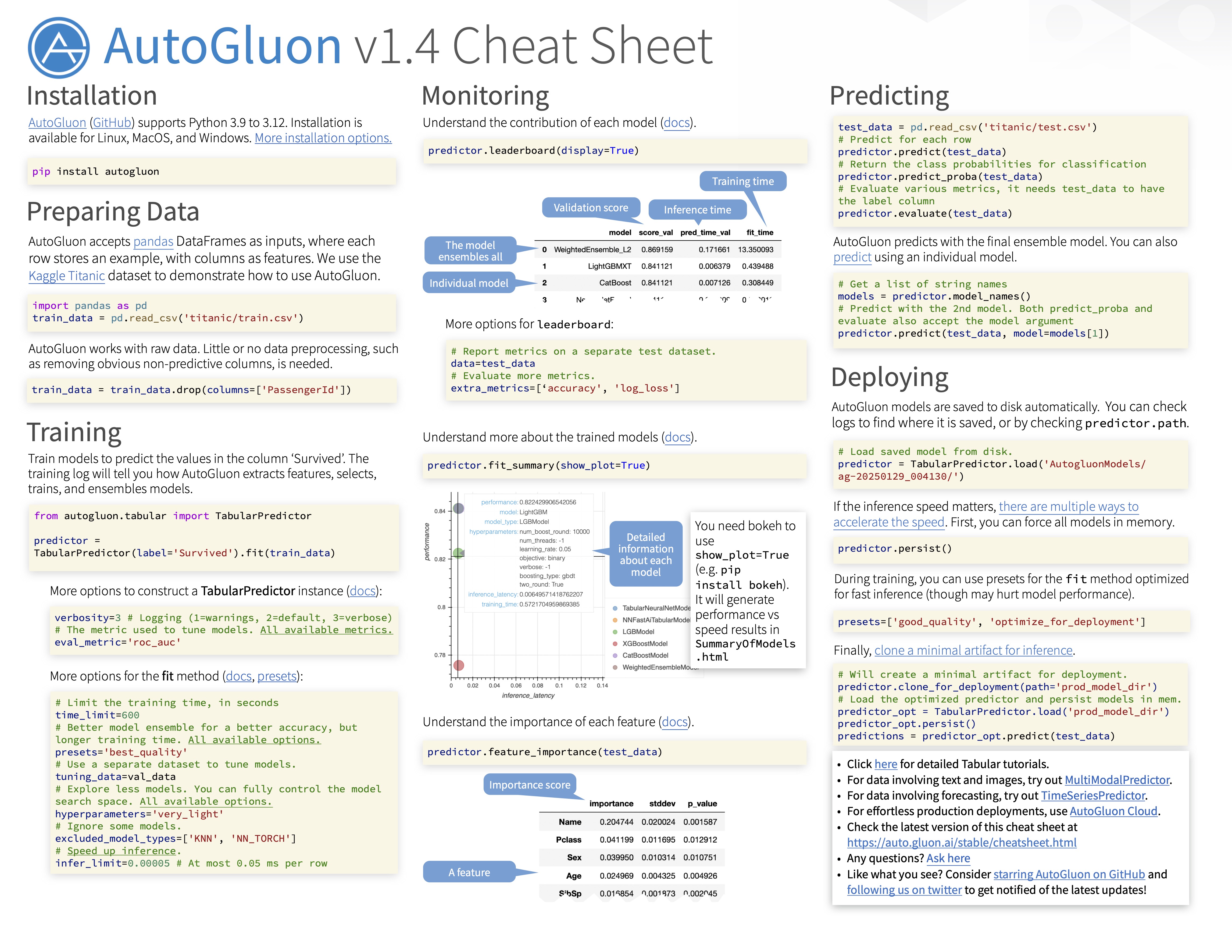

图:AutoGluon 官方 Cheat Sheet,来源:AutoGluon Cheat Sheet。

Baseline 的真正成本

传统机器学习的 baseline 通常长这样:

- 用

pandas清洗数据,修复类型、缺失值和异常值; - 用

sklearn.pipeline拼接数值特征、类别特征和文本特征的处理逻辑; - 先跑 Logistic Regression、Random Forest、XGBoost、LightGBM、CatBoost 等模型;

- 用 GridSearch、RandomSearch 或 Optuna 做超参数搜索;

- 用交叉验证确认结果稳定性;

- 再额外记录训练时间、推理时间、模型大小和验证分数。

这套流程并不业余,问题在于它太容易把早期探索变成工程泥潭。你花了两天时间搭出一个还算体面的 pipeline,最后才发现数据本身信号不足,或者业务指标定义根本不对。此时,手写 pipeline 的精细程度并没有转化成项目收益。

AutoGluon 的思路更像是:先把 baseline 这件事产品化。它默认帮你做足够鲁棒的自动处理和模型组合,让你先得到一个很难被随便超过的参考点,再决定是否值得继续投入更重的人力。

AutoGluon 的核心设计思想

我觉得理解 AutoGluon,不应该从某个参数开始,而应该从它背后的几个设计选择开始。

统一抽象:Predictor 作为任务入口。

AutoGluon 的多个模块都围绕类似的工作流展开:

predictor.fit(train_data)

predictions = predictor.predict(test_data)

predictor.evaluate(test_data)

predictor.leaderboard(test_data)

这套接口的好处不只是简单。它把不同机器学习任务都组织成几个稳定动作:训练、预测、评估、比较。

对使用者来说,这意味着你不必在项目早期过度关心底层模型族、特征处理细节和验证流程。你先用统一接口跑起来,拿到一个结果基线,再决定要不要下钻。

自动化优先:把重复性工程内置进框架。

AutoGluon 会自动识别字段类型,处理缺失值、类别特征、数值特征和部分文本特征,并根据任务选择合适的模型集合。对于表格数据来说,这一点尤其重要,因为真实业务数据往往不是干净的矩阵,而是混杂着整数、浮点数、类别、日期、文本、ID、缺失值和各种奇怪编码的 DataFrame。

这不代表我们可以忽略数据理解。AutoGluon 更适合把默认工程处理交给框架,把人的注意力释放到更值得人工判断的问题上:标签是否可靠?特征是否泄漏?训练集和线上分布是否一致?业务指标是否定义正确?

Ensemble-first:重集成,轻手工调参。

很多 AutoML 工具的叙事重心是搜索:在算法和超参数空间里寻找一个最优模型。AutoGluon 的哲学更偏向 ensemble-first:与其赌一个单体模型,不如训练一批互补模型,再通过 bagging、stacking 和 weighted ensemble 组合它们。

图:AutoGluon-Tabular 多层 stacking / ensemble 工作机制示意,来源:AWS SageMaker AutoGluon-Tabular 文档。

这也是 AutoGluon 经常能快速给出强 baseline 的原因之一。它不依赖猜测这次到底该用哪个模型,而是让不同模型在统一验证框架下竞争与协作。代价也很明确:集成模型通常更大,推理链路更长,解释性也可能不如单一模型清晰。

Leaderboard-first:结果必须可比较。

AutoGluon 的 leaderboard() 很重要,因为它把训练过程从一个黑箱分数变成了一张可比较的实验表。你可以看到每个模型的验证分数、测试分数、训练时间、推理时间和 stack level。

这张表不只是“排名”。它回答的是工程决策问题:

- 如果只追求分数,应该选哪个模型?

- 如果推理延迟更重要,能不能牺牲一点分数换更快模型?

- 加上 bagging/stacking 后,收益是否值得额外成本?

- 是否存在训练分数很好但测试表现不稳定的模型?

换句话说,AutoGluon 自动训练模型,同时帮你整理实验账本。

图:基于 AutoGluon 官方 Tabular 教程中的 leaderboard 字段绘制的示意图。横轴是 pred_time_test,纵轴是 score_test,可以直观看到“最高分模型”和“更快模型”之间的取舍。参考:AutoGluon Tabular In Depth。

Baseline-first:先建立性能锚点。

我最喜欢 AutoGluon 的用法,是把它作为项目早期的性能锚点,而不是让它替我完成所有建模工作。

当 AutoGluon 在短时间内给出一个强 baseline 后,后续讨论会清晰很多:

- 如果人工模型比它差很多,说明 pipeline 或特征处理可能有问题;

- 如果人工模型略好但复杂很多,需要评估收益是否值得;

- 如果 AutoGluon 也表现很差,问题可能不在模型,而在标签、特征、样本量或任务定义;

- 如果 AutoGluon 表现很好但推理太慢,可以考虑蒸馏、refit 或保留较轻量的单体模型。

模块架构:AutoGluon 到底覆盖了什么?

AutoGluon 现在已经扩展到表格 AutoML 之外。更准确地说,它是一组围绕 Predictor 抽象组织起来的自动机器学习模块:上层用相似的接口承接训练、预测、评估和结果比较;中间层根据任务类型选择 Tabular、Time Series 或 MultiModal 等能力;底层再组合特征处理、模型库、集成策略和 leaderboard 记录。

这种结构的好处是,使用者不需要在每个任务上重新学习一套完全不同的工程范式。表格、时间序列和多模态任务的底层模型差异很大,但它们在 AutoGluon 中都尽量被包装成“给数据、设目标、训练、比较、迭代”的工作流。

Tabular:最经典的强 baseline 场景。

autogluon.tabular 是 AutoGluon 最经典、也最能体现其设计哲学的模块。它面向表格分类、回归和排序任务,可以直接接受 pandas.DataFrame,自动处理特征并训练多个模型。

在很多业务场景里,表格数据仍然是最常见的数据形态:用户画像、交易记录、问卷数据、运营指标、风控特征、实验数据、结构化日志。AutoGluon Tabular 的价值就在于,它能把这些数据快速变成一个可比较的模型基线。

最小示例大概是这样:

from autogluon.tabular import TabularDataset, TabularPredictor

train_data = TabularDataset(

"https://autogluon.s3.amazonaws.com/datasets/Inc/train.csv"

)

test_data = TabularDataset(

"https://autogluon.s3.amazonaws.com/datasets/Inc/test.csv"

)

label = "class"

predictor = TabularPredictor(label=label, eval_metric="accuracy").fit(

train_data,

time_limit=300,

presets="medium_quality",

)

predictor.evaluate(test_data)

predictor.leaderboard(test_data)

如果你愿意花更多训练时间追求更强性能,可以尝试:

predictor = TabularPredictor(label=label, eval_metric="accuracy").fit(

train_data,

time_limit=1800,

presets="best_quality",

)

但这里的关键不是记住 presets 参数,而是理解它背后的取舍:更强的配置通常意味着更多模型、更复杂的集成、更长的训练时间和更高的推理成本。

Time Series:把 forecasting 也纳入统一工作流。

autogluon.timeseries 面向时间序列预测。它延续了 Predictor、evaluate、leaderboard 的工作方式,但任务目标变成了 forecasting,关注历史序列、预测窗口、协变量和概率预测。

这意味着你可以用相对统一的心智模型处理另一类常见问题:销量预测、流量预测、库存预测、指标趋势预测等。相比手动拼接传统统计模型、深度时序模型和回测流程,AutoGluon Time Series 的目标仍然是快速得到一个可比较的强基线。

MultiModal:文本、图像、表格的统一入口。

autogluon.multimodal 面向更复杂的数据形态:文本、图像、表格字段可以同时出现在一个任务中。它覆盖分类、回归、语义匹配、目标检测、embedding 提取等场景。

图:AutoGluon MultiModal 官方 Cheat Sheet,来源:AutoGluon Cheat Sheet。

这个模块的意义在于,很多现实数据并不是单一模态。例如商品数据可能同时有标题、描述、价格、类目和图片;简历筛选可能同时有结构化字段和长文本;质检数据可能同时有传感器表格和图像。MultiModalPredictor 试图把这些混合输入包装进统一训练流程。

Features:自动特征处理的基础层。

autogluon.features 更像是支撑层。它负责自动类型推断、特征元数据、特征生成和转换等能力。虽然普通用户不一定会直接使用它,但它解释了为什么 AutoGluon 可以接收相对原始的数据表,而不要求你先手写完整的预处理 pipeline。

当然,自动特征处理不是魔法。ID 泄漏、时间穿越、目标编码泄漏、训练和线上字段不一致,这些问题框架无法替你完全判断。AutoGluon 可以减少样板工程,但不能替代数据审计。

Cloud / SageMaker:从本地实验到托管流程。

AutoGluon 也和 AWS / SageMaker 生态有集成,用于托管训练、模型部署和云端工作流。对于个人实验或小项目,本地跑通通常已经足够;对于团队和生产环境,云端集成的价值在于资源管理、可复现训练和部署链路。

本文不展开 SageMaker 操作细节,因为这会把主题带向云平台教程。这里只需要知道:AutoGluon 的设计并不局限于 notebook 里的快速实验,它也可以进入更完整的工程体系,并且与 AWS / SageMaker 生态的集成比较自然。

AutoGluon 和其他工具的差异:以及 Agent 时代的 AutoML 想象

AutoGluon 不会吊打所有工具。更准确的说法是:不同工具服务于不同阶段和不同约束。

| 工具 / 路线 | 更擅长什么 | 和 AutoGluon 的差异 |

|---|---|---|

| 手写 sklearn / XGBoost / LightGBM | 可控、轻量、容易嵌入生产 pipeline | 需要自己处理特征、验证、调参和实验管理 |

| auto-sklearn / TPOT | 搜索式 AutoML、算法选择、pipeline 搜索 | 更强调搜索最优 pipeline,AutoGluon 更强调集成和强默认值 |

| H2O AutoML | 企业级平台化、可视化、治理和部署生态 | 平台能力更完整,但轻量脚本化体验不同 |

| PyTorch / TensorFlow | 高度自定义模型、端到端深度学习研究 | 灵活性强,但表格 baseline 往往工程成本更高 |

| AutoGluon | 快速、鲁棒、可比较的强 baseline | 模型可能更重,推理更慢,解释性和部署可控性需要额外处理 |

如果你的目标是做一个严格可控、极低延迟、只依赖单个模型文件的生产服务,最终方案未必是 AutoGluon 的完整集成模型。但如果你的目标是在项目早期快速回答“这个数据有没有价值、模型大概能做到什么水平”,AutoGluon 非常适合。

不过,如果把时间尺度稍微拉长,AutoML 的生态可能会被语言模型和 Agent 改写一部分。

过去的 AutoML 更像是搜索器:给定数据、任务和指标,它在预设的 pipeline 空间里搜索模型、特征处理和超参数。AutoGluon 则更像是强默认工作流:它不执着于找到一个单体最优解,而是用一组鲁棒默认策略和集成模型快速建立强 baseline。

但语言模型和 Agent 带来的新变量是:它们开始具备读懂上下文并组织实验的能力。一个 Agent 可以先查看数据 schema、字段含义、缺失模式和目标变量,再决定应该尝试表格模型、时间序列模型、多模态模型,甚至自动写出清洗代码、运行实验、观察 leaderboard、修改 pipeline。换句话说,根据数据类型找到一个很强的模型这件事,正在从传统 AutoML 的搜索问题,变成 Agent 可以参与的端到端数据科学工作流问题。

这并不是纯粹想象。近两年已经有不少工作在朝这个方向推进:OpenAI 的 MLE-bench 用 Kaggle 竞赛任务评估机器学习工程 Agent;MLAgentBench 关注 LLM Agent 在机器学习实验中的规划、编码和迭代能力;Data Interpreter 尝试让 LLM Agent 自动完成数据科学任务;也有 AutoML-Agent 这类工作直接把多智能体思想引入自动机器学习流程。

这会怎样影响 AutoGluon 这类框架?我的判断是:它们不会简单被 Agent 替代,反而可能成为 Agent 的工具层。

原因很简单。Agent 擅长理解任务、拆解步骤、写胶水代码和根据反馈迭代,但它仍然需要稳定、可调用、结果可比较的底层工具。AutoGluon 正好提供了这样的能力:统一的 Predictor 接口、自动特征处理、强 baseline、leaderboard、模型保存与复用。一个面向数据科学的 Agent,与其从零手写 sklearn pipeline,不如优先调用 AutoGluon 建立基线,再根据结果决定下一步:做数据清洗、特征审计、模型蒸馏,还是改用更专门的模型。

在这个视角下,AutoGluon 的价值不会消失,只是角色会变化:它不一定是用户直接面对的最终界面,而可能成为 Agent 背后最值得信赖的 baseline engine。

拿到强 Baseline 之后,应该做什么?

AutoGluon 给出强 baseline 以后,真正有价值的工作才刚开始。这个 baseline 不应该被看成终点,而应该被看成一把尺子:它帮我们判断当前数据质量、任务定义和工程投入是否值得继续推进。

第一步通常不是继续调参,而是做误差分析和数据审计。先看错在哪里:哪些类别错得多?哪些样本置信度很高但预测错误?错误是否集中在某些时间段、地区、用户群体或数据来源?如果错误模式很清楚,最高收益动作往往不是换模型,而是修标签、补特征、拆任务,或者重新定义业务指标。

同时,强 baseline 有时也可能是坏消息。分数高得不正常,可能意味着目标泄漏、时间穿越或训练/测试切分方式不符合真实业务流程。比如某个特征在预测时点其实不可用,或者测试集里混入了和训练样本高度重复的数据。AutoGluon 能快速给出高分,但不能自动证明这个高分可信;数据泄漏检查仍然是人的责任。

接下来才是工程取舍。leaderboard 可以帮助你在准确率、训练时间和推理时间之间做选择。很多时候,最高分模型未必是最适合上线的模型;一个分数略低但推理快很多、结构简单很多的模型,可能才是更好的工程解。如果完整集成模型太大、太慢,可以考虑保留表现较好的单体模型,或者使用蒸馏、refit、模型持久化和推理优化能力,把 AutoML 产物转化成符合业务约束的方案。

最后,baseline 还应该进入长期迭代闭环。模型上线后,它可以作为后续版本的参考线:新特征是否真的有效?新模型是否稳定超过旧模型?线上数据分布是否已经偏离训练数据?AutoGluon 解决的是快速建立可信起点,不是永久替代模型生命周期管理。

小结

AutoGluon 很适合建立强 baseline,但它也有明显代价:

- 集成模型可能占用更多磁盘和内存;

- stacking / bagging 可能增加推理延迟;

- 自动特征处理降低了样板代码量,也可能让部分细节不够透明;

- 多模型依赖会增加部署和版本管理复杂度;

- 对强业务约束、强因果解释或极低延迟场景,最终仍可能需要手写 pipeline。

所以,我会把 AutoGluon 放在机器学习工具链的早期高价值位置:先用它建立强 baseline,再决定是否做人工特征工程、自定义模型、轻量化部署或更严格的生产治理。

它让我们更快地走过模型选择、特征处理和实验比较的早期泥潭,把注意力放回更重要的问题:数据是否可靠,任务是否定义正确,指标是否有业务意义,以及这个模型是否值得被真正部署。